Det fremste eksempelet på at politikken har inntatt SXSW. Det demokratiske stjerneskuddet Alexandria Ocasio-Cortezn (AOC blant venner, og de var det mange av i Austin) eide den store salen i Convention Center denne ettermiddagen.

Foto: NTB scanpix

SXSW Halvor Tretvoll

Her er Halvor Finess Tretvolls rapport fra SXSW 2019.

Stipendrapport: Halvor Finess Tretvoll, redaktør Agenda Magasin

9. mars 2019

09.30: Katryna Dow – Two Choises for Humanity´s Digital Future

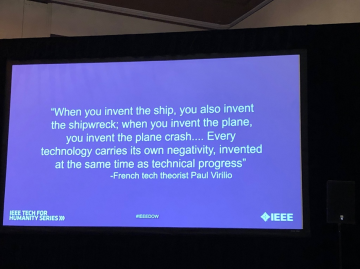

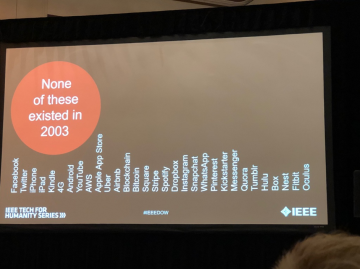

Vi står overfor et veivalg: Vil vi at teknologien skal bli et gode eller en trussel mot menneskelig velferd?

Forretningsmodellen til dagens tech-giganter baserer seg i stor grad på å samle inn data om brukerne. Denne informasjonen kan så brukes i kommersielle øyemed, først og fremst til å målrette reklame, men ikke bare det. Allerede finnes det tjenester som gjør billige gentester, og som holder på dataene i ti år. Snart vil vi ha bots på innsiden av kroppene våre. De vil kunne varsle om sykdom, men også samle informasjon som helseforsikringsselskapene vil være interessert i. Det finnes også andre eksempler. Audi lanserte nettopp en bil som kan kommunisere med trafikklys. Samtidig registrerer kinesiske myndigheter trafikkforseelser gjennom systemer for ansiktsgjenkjenning. De som kjører på rødt kan møte forskjellige typer sanksjoner.

Tech er i utgangspunktet nøytralt, men vi står på terskelen til en ny ære der den fysiske verden, den digitale og den biologiske vil smelte sammen. Det nye brukergrensesnittet vil bli hjernebarken. Allerede har tre hjerner (og menneskene som er festet til dem) spilt dataspill sammen ved Washington University). Er vi trygge på at teknologien vil tjene allmennheten i en slik framtid? Legg til angrepene på sannheten, dannelsen av ekkokammere, techgigantenes utrettelige og manipulative bestrebelser etter å få oss til å bruke mest mulig tid på deres tjenester, nye overvåkningsmuligheter og alle tenkelige former for potensielt misbruk av den informasjonen som er samlet inn.

Det vil snart ikke finnes den ting som ikke selskapene vet om oss. De skal tjene penger, og vil ikke nøle med å kommersialisere informasjonen om de får anledning til det.

Det er behov for en ny visjon: Minimum collection, maximum value. Problemet er: Hvordan skal selskapene da tjene pengene sine? Hvor skal insentivene for å videreutvikle tjenestene da komme fra?

Utviklingen av kunstig intelligens utgjør en spesielt stor fare. Bevissthet er et vanskelig emne, derfor vil vi trolig gjøre feil. Sannsynligvis gjør vi enkelte av dem allerede.

Vi må tilbake til noen grunnleggende prinsipper. AI-utviklingen må være forankret i etikken. Den massive datainnsamlingen, de føringene som alltid vil bli lagt inn i selv de mest avanserte AI-systemene må være basert på en forpliktelse til å sette fellesskapets beste først. Asymmetrien mellom de mektige selskapene og de avmektige forbrukerne må endres. Vi må gis handlefriheten og kontrollen tilbake. Problemet er: Politikken rekker sjelden å holde tritt med utviklingen. Reguleringene kommer stort sett for sent.

Valget vi står overfor er: Ny digital feudalisme eller ny digital renessanse?

11.00: Jim Bankoff (Vox Media), intervjuet av Soledad O´Brien (Starfish)

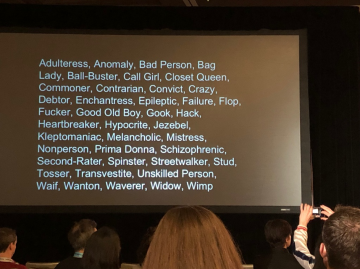

12.30: Kate Crawford og Trevor Paglen – De skjulte forutsetningene i datasettene som AI trener seg på

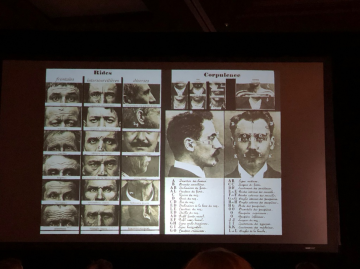

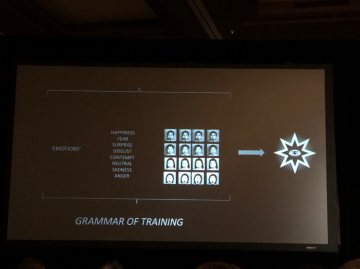

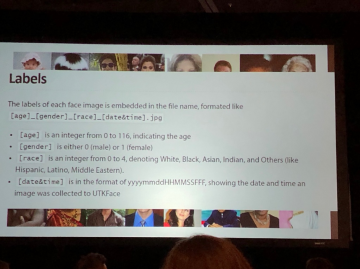

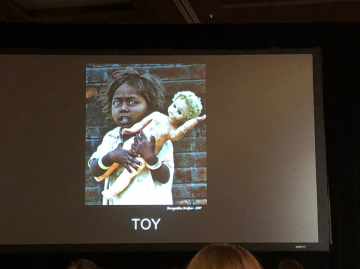

Imagenett den største fotodatabasen med mennesker. Bildene er kategorisert. Brukes til å trene kunstig intelligens, slik at bildegjenkjenningsfunksjoner skal bli bedre.

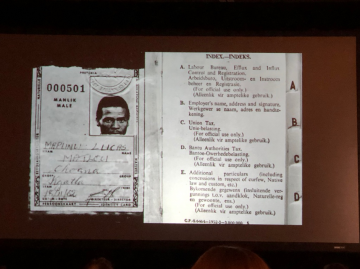

Det er store problemer med å få en datamaskin til å lese bilder og legge betydninger inn i dem, slik vi gjør når vi ser på verden. Våre kategorier er ikke trekk ved verden som kan avleses uten videre. Måten vi kategoriserer på er betinget av vår tilværelse. Når det er snakk om å kategorisere mennesker, blir dette enda mer problematisk. Mange av historiens spøkelser går igjen i datasettene som AI trenes opp med.

Eksemplene taler for seg:

Kategoriene er ofte merksnodige:

Taxonomien i slike sett velges ofte fordi det passer med AI-behovene. Det ligger politiske ideer skjult i dette. Se for eksempel på kategoriene for rase og for kjønn.

Ofte får dette et slags vitenskapelig preg, siden det er teknologer i datalabber som jobber med datasettene, men her burde sosiologen, historikeren og filosofen også vært konsultert.

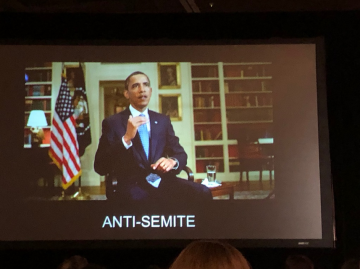

Imagenett har ambisjoner om å kategorisere hele universet av objekter i verden. Men hva er egentlig et objekt? Hvor slutter det første, og hvor begynner det neste? Å kategorisere er å gjøre vold mot verden. Kategoriene er konstruksjoner vi tenker med. De finnes ikke egentlig. Når man lager kategorier for mennesker, blir dette raskt komplisert og problematisk. Imagenett har 1,2 millioner bilder av mennesker, og opererer med 3000 kategorier som disse bildene tilskrives. Mange av dem feller dommer over menneskene som er avbildet, og vil føre til at bildegjenkjenningsprogramvaren gjør det samme i møte med nye bilder som ligner dem det kjenner fra datasettet.

AI er foreløpig helt ute av stand til å kompensere for dette, enn si forstå problemet. Vi er altså langt unna en fungerende kunstig bevissthet.

Det er viktig å bevare treningssettene for å kunne dokumentere historien bak utviklingen av kunstig bevissthet.

De store selskapene jobber intenst med bildegjenkjenning. Alle bildene du selv tenker på som private minner fra ferieturen i fjor, delt med en engere krets på sosiale medier, inngår nå i datasettene til noen av de aktørene som er lengst framme når det gjelder utviklingen av kunstig intelligens. Vi vet ikke mye om hvordan de kategoriserer og klassifiserer. Men vi vet at denne kategoriseringen og klassifiseringen er en dypt politisk handling, som det dessverre er for lite diskusjon rundt.

14.00: Senator Elizabeth Warren (D), intervjuet av Time Magazine Editor at Large Anand Giridharadas.

Lanserte her sin store pakke med tiltak for å regulere tech-selskapene i større grad. Warrens hovedpoeng er at de bør deles opp. Dette var en tiltakspakke som man stadig vendte tilbake til i de mange diskusjonene om de problematiske sidene ved tenkologiutviklingen de neste dagene.

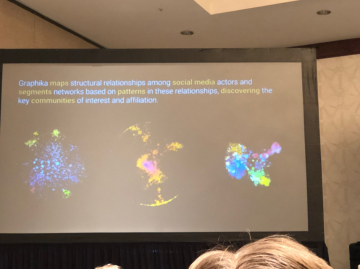

15.30: John Kelly (Graphika) – A global tour of disinformation.

Graphika analyserte russernes påvirkningskampanje på sosiale medier i 2016-valgkampen for den amerikanske Kongressen. De fikk tilgang til data fra selskapene og gjorde flere interessante funn, som at de russiske påvirkningsagentene var i besittelse av en dyp forståelse av amerikansk kultur og samfunnsliv. De behersket narrative som driver samfunnsdebatten i USA. For å ta et eksempel: Trollfabrikken Internett Research Institute i St. Petersburg brukte tv-serien House og Cards som referanse. De visste hvem vi er, hvor vi kommer fra, hvor vi skal og hva som er viktig for oss, altså nøkkelelementene i ethvert samfunn. De visste at nøkkelen til å bygge og styrke, eller bryte i stykker, fellesskap er historier. Dette handler ikke bare om å påvirke utfallet av valg, i USA og andre steder, men i en dypere forstand om å forstyrre et samfunns naturlige utvikling med den hensikt å destabilisere det.

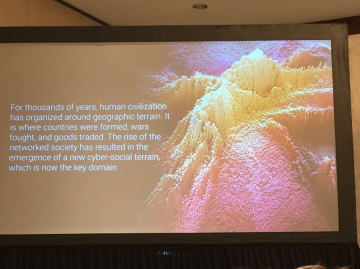

Graphika ager avanserte 3D-modeller av de organiske nettverksforbindelsene som definerer kommunikasjonen i moderne samfunn. Verdens framtid står på spill i den utviklingen som finner sted i det Graphika kaller et cyber-sosialt rom der geografiens betydning er opphevet og utvekslingen av informasjon og desinformasjon skjer i sanntid på tvers av enorme avstander.

Weaponized polarizaton er bevisst manipulering gjennom kontinuerlig roping fra mange kilder samtidig. Dette skjer på både høyre- og venstresiden. Strategien blir mer effektiv når et allerede finnes store mengder desinformasjon der ute. Da sås det en grunnleggende tvil om man i det hele tatt kan stole på noe. I dette vakuumet trives konspirasjonsteoriene og de hatefulle angrepene.

17.00: Alexandria Ocasio-Cortez, intervjuet av Briahna Gray fra The Intercept

Det fremste eksempelet på at politikken har inntatt SXSW. Det demokratiske stjerneskuddet Alexandria Ocasio-Cortezn (AOC blant venner, og de var det mange av i Austin) eide den store salen i Convention Center denne ettermiddagen.

Det mest interessante AOC snakket om var hvordan Demokratene burde forholde seg til alle de menneskene i USA som føler seg sviktet av den politiske klassen. Her var hun svært god:

- Ikke gå inn i samtalen for å overbevise den andre, eller for å slå fast at vedkommende er en idiot. Still opp med en genuin vilje til å lytte.

- Må avvæpne disse møtene, for det er mye gjensidig fiendtlighet.

- Kanskje skifter ikke folk mening umiddelbart, men erfaringen er at de tar med seg noe fra slike møter som kan spire og føre til at folk skifter mening senere.

- Dette handler ikke bare om å ha de beste argumentene, men også om hvordan man får folk til å føle seg.

- Gi folk en mulighet til å foreta en verdig retrett i løpet av samtalen, slik at man ikke låser seg fast i posisjoner.

Hun presenterte i tillegg sin ambisiøse plan for en New Green Deal, som har skapt en global debatt om en rettferdig grønn omstilling av økonomien. «Vi landet på månen. La oss ikke velge vekk et mål fordi vi ennå ikke vet i detalj hvordan vi skal nå det. Gjør det heller til en prioritert oppgave å finne ut av alle disse detaljene, nettopp fordi vi har bestemt oss for at vi skal et sted.»

Tar også et oppgjør med de uskrevne lovene i politikken. «What people think will win, is wrong». Utgangspunktet må være et ektefølt engasjement, ikke forsøk på å triangulere. I primærvalget: Stem på den kandidaten du liker, ikke den du tror har størst sjanse til å vinne.

10. mars 2019

11.00: Susan Fowler (The New York Times) – The Power of a Story.

Et intenst oppgjør med elendig bedriftskultur i Uber.

12.30: Eric Klinenberg (New York University) – Palaces for the People

Forfatter av ny bok som slår et slag for betydningen av fysiske møtesteder, ikke minst bibliotekene, og generelt en bedring av det han kaller den «sosiale infrastrukturen» i byområder. Der den er til stede lever folk lenger, de er lykkeligere og står bedre rustet til å håndtere naturkatastrofer og andre plutselige hendelser. Uten blir vi isolerte og mer utsatte. Under en hetebølge i Chicago for noen år siden kunne den sosiale infrastrukturen i et område avgjøre spørsmål om liv og død. Der folk møttes og kjente til hverandre, var det også flere som sjekket om naboen trengte bistand. Slik ble mange reddet, som i dårligere stilte nabolag (der den sosiale infrastrukturen var mindre utbygd), omkom. Selv når det var kontrollert for alle mulige andre risikofaktorer, besto denne forskjellen.

Klinenberg ble hyret av Obama-administrasjonen for å organisere en byutviklingskonkurranse i forbindelse med gjenoppbyggingen etter stormen Sandy. Man brukte klimatilpasningen til å forbedre den sosiale infrastrukturen i byen. Klinenberg ser det som en viktig komponent i en New Green Deal.

Forsøker virkelig å drive poenget gjennom: Forestill dere at vi ikke hadde arvet alle de institusjonene, de fysiske møteplassene, som vi har i dag. Om man skulle forsøke å få politikerne i dag med på et lignende løft som utbyggingen av bibliotekvesenet i sin tid var, ville det vært nærmest umulig. Ber oss ta bedre vare på arven, sikre finansieringen, utvide åpningstidene, gjøre vedlikehold osv. I tillegg bør vi, mener Klinenberg, bruke noen av de enorme ressursene som vil gå med til klimatilpasning og infrastrukturprosjekter til å utbedre den sosiale infrastrukturen. «De store tech-selskapene gir oss telefoner og hevder at vi kan skape meningsfulle sosiale bånd gjennom den. Samtidig skaper de – for seg selv – områder der det faktisk finnes en sosial infrastruktur, i Googles og Facebooks hovedkvarter. Som om ikke det var nok, nekter de til og med sine egne barn å ha telefon.

14.00: Robert McNamee (Elevation Partners), intervjuet av sjefredaktør Nicholas Thompson i Wired

Fra den store scenen i Austin Convention Center fortalte McNamee om en allestedsnærværende teknologioptimisme som preget venturekapitalistmiljøet han var en del av da han først møtte Facebook-gründer Mark Zuckerberg. «Alle mente den gang at teknologien var en kraft for det gode,» sa McNamee fra scenen. Det var en tenkemåte han selv også var besmittet av. Siden har han imidlertid kommet på andre tanker: «Det var en ideologi som fungerte utmerket for Silicon Valley og start up-ene der,» sier han nå.

For brukerne og for samfunnet forøvrig, har den ikke fungert like bra. McNamee forsøkte å få sine venner i Facebook til å innse at de hadde skapt et monster, men han måtte istedenfor erkjenne at de ikke ville høre, at de ikke var interessert i å endre en forretningsmodell som genererer enorme verdier, men i virkeligheten går ut på å samle privat informasjon og å forsøke å styre menneskelig adferd på detaljnivå.

Problemet, slik McNamee ser det, er at forretningsmodellen ble skapt bak et slør av teknooptimisme, lovnader om å knytte mennesker og verden tettere sammen og det man helt klart også må innrømme at er en god tjeneste som brukerne liker.

15.30: AI and the future of Storytelling med Douglad Eck (Google), Charles Melcher (Future of StoryTelling), Heather Smith (StoryFile) og Lance Weiler (Columbia University)

Et panel som viste fram hva kunstig intelligens kan innebære i historiefortelling, men enkelte eksempler. Smith presenterte et prosjekt der man kan snakke med døde slektninger (rart) eller Holocaust-overlevende (mer nyttig, kanksje).

Ellers er det mest interessante eksempelet så langt på hva AI-generert historiefortelling kan innebære den teksten som er startet av et menneske, og så autogenerert av en kunstig intelligens deretter.

11. mars 2019

09.30: Helen Papagiannis - Augmented Reality: Amplifying Human Intelligence

En statusrapport fra forfatteren bak boka Augmentet Human: How Technology is Shaping the new Reality om hvor langt menneske/maskin-integrasjon har kommet og hva AR gjør godt/dårlig.

Briller er bare starten. Hva med kunstig smak før du bestiller mat på restaurant?

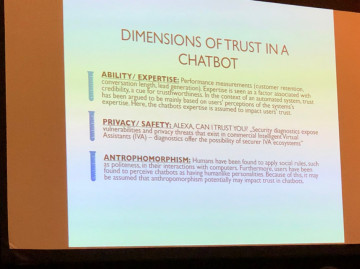

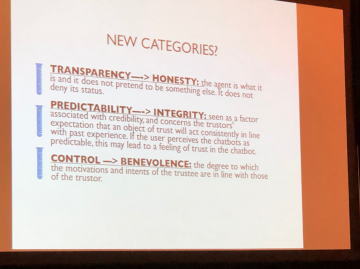

11.00: Aleksandra Przegalinska – Will Machines Be Able to Feel?

Det korte svaret på spørsmålet i overskriften er nei. Men mer kan sies. For hva er egentlig en følelse? Maskiner har ikke store, menneskelige følelser, men de kan reagere på stimuli. En slik tynn definisjon av hva som utgjør en følelse, innebærer at spørsmålet blir vanskeligere å besvare.

Vi har en grunnleggende ambivalens stilt overfor denne muligheten. På den ene siden streber vi etter mer menneskelignende AI. På den andre siden frykter vi det.

Dermed er ikke spørsmålet bare om AI kan bli likere oss, men også om vi egentlig vil det.

Begynner med en situasjonsbeskrivelse av AI i dag og i den nære framtida.

Per i dag har vi ikke egentlig kommet særlig langt på utviklingsbanen. Vi simulerer bevissthet, uten at det egentlig er snakk om intelligente responser. Men vi kan bygge fra bunnen og oppover. Alexa har ikke utfylt potensialet sitt, for å si det slik.

Alpha GoZero, et dypt nevralt nettverk, vil snart kunne brukes til å stille medisinske diagnoser. Google Duplex er det vanskelig å avsløre i en Turing-test (som går ut på å skulle bestemme om man kommuniserer med et menneske eller en maskin). Project Debater innebar at en kunstig intelligens deltok i en faktisk debatt. Her var det ikke bare naturlig språkgjenkjenning, men også narrativer, argumentasjon og så videre. GPT2 er maskinen som forteller historien om enhjørningene som kan snakke engelsk.

Slik Przegalinska ser det, kan man derfor lure på om Turing-testen er over. Spørsmålet er likevel om vi kan overskride det som kalles en «uncanny valley» i utviklingen av AI.

Et interessant eksperiment, der selv folks emosjonelle reaksjoner ble tilbakeført i systemet, viser at folk har større tillit til en ren tekst chat-bot en til en med et menneskelig ansikt. Det oppstår flere følelser i tilknytning til sistnevnte, men de er overveiende negative. Etter ett år med interaksjon hadde boten utviklet en slags personlighet som det var mulig å avlese. Hun var journalist og miljøaktivist («tree hugger»). Poenget er imidlertid at AI enn så lenge speiler holdningene til gruppene den kunstige bevisstheten interagerer med. Den har imidlertid ikke hukommelse eller noen stabil identitet som holder seg over tid.

For den videre utviklingen er det flere retningslinjer som bør følges:

12.30: Douglas Rushkoff – Team Human

Medieteoretikeren Douglas Rushkoff, en professor som har skrevet ti bøker om nettalderen, som har (hatt) teknologispalter i The New York Times og The Guardian – en mann som også har skapt begreper som «digital native», «viral media» og «social currency» - går enda lenger enn McNamee i sin kritikk av teknologigigantene. Til SXSW kom han for å snakke om sitt manifest for en mer menneskelig teknologiutvikling, kalt «Team Human».

Medieteoretikeren Douglas Rushkoff, en professor som har skrevet ti bøker om nettalderen, som har (hatt) teknologispalter i The New York Times og The Guardian – en mann som også har skapt begreper som «digital native», «viral media» og «social currency» - går enda lenger enn McNamee i sin kritikk av teknologigigantene.

På SXSW snakket han om sitt manifest for en mer menneskelig teknologiutvikling, kalt «Team Human», og det var vanskelig å unnslippe følelsen av at en omfattende teknologifiendtlighet her hadde overtatt for den naive teknologioptimismen.

«Det har blitt lettere å forestille seg verdens ende enn kapitalismens slutt,» begynte Rushkoff. I hans øyne er ikke bare overvåkningen og misbruk av privat informasjon et problem. Slik professoren ser det, fungerer teknologien snarere som en form for medisin eller dop, like effektivt som LSD.

«I dag har vi glemt hva medisinen skulle gjøre for oss. Vi har istedenfor blitt avhengige av den, og befinner oss i dag på en dårlig syretripp,» sier han. «Drømmen som ble realisert handler om å øke verdien på børsen, ikke om å utløse menneskelig kreativitet og økt kontakt, slik ideen var i San Fransisco før 2000.»

I hans øyne sluttet man å spørre hva man kan gjøre for folk. Istedenfor begynte man å tenke på hva man kan få folk til å gjøre. Istedenfor å lage teknologi som vi bruker, lager gigantene i dag teknologi som bruker oss. Det er smarttelefonen som blir smartere når du bruker den. Selv blir du bare dummere og dummere.

Med Rushkoffs ord er det menneskeligheten vår som blir tatt fra oss. Vi blir skremte og atomiserte individer som er lette å manipulere. Teknologien blir en flukt. Der fortsetter fremmedgjøringen og manipulasjonen. Samtidig undergraves demokratiet og sammenhengskraften i samfunnet.

«Team Human» handler om å lage en plass for menneskene i framtida. Det går ut på å tvinge selskapene til å anerkjenne en grunnleggende menneskelig verdighet, samtidig som vi alle må bli tech-litterate og i stand til å se bak de fine frasene for å forstå teknologiens virkelige makt over våre liv.

Så ble det tid til en tur på Trump Twitter Library

17.00: Eli Pariser – What Does Healthy Technology Look Like?

Eli Pariser, medstifter av Upworthy og forfatteren bak boka The Filter Bubble: What the Internet Is Hiding from You har en mer konstruktiv tilnærming. Han forsøker å finne et språk som kan få tech-gigantene til å forstå hva problemet er, og å operasjonalisere det slik at det kan brytes ned i målbare indikatorer.

Han vil ikke ha gaffateip-løsninger som kommer i stand fordi noe hangler, men en grunnleggende gjennomtenkning av grunnlaget for teknologiselskapene som sikrer at de skaper genuint meningsfull mellommenneskelig interaksjon som sikrer enkeltindividers og samfunnets velvære.

Ifølge Pariser er det ikke så mye som skal til, nødvendigvis, men målene må endres. Gjør man relativt beskjedne forandringer i kommunikasjonssituasjonen som medieplattformene

legger til rette for, kan det bety mye for adferden folk utviser på plattformene. «Man må gjøre det lett å handle rett,» som han formulerer det.

Det er selvsagt en rekke problemer som må løses, og det største av dem handler trolig om å finne en mer menneskelig forretningsmodell som fortsatt er en forretningsmodell. Når det kommer til stykket, vil idealisme neppe rekke særlig langt når problemet er så massivt og systemisk som dette.

Hvis du bruker de aller smarteste menneskene på koden til å pønske ut hvordan du kan få folk til å bli noen sekunder lenger på en eller annen plattform, får det negative konsekvenser. Det er i tillegg en massiv sløsing med menneskelige ressurser som kunne blitt brukt til noe mer verdifullt, som å forsøke å finne ut hvordan man kan gjøre det.

12. mars 2019

09.30: Lining Yao - Morphing into the Future: "Shapeshifter" Materials

Linning Yao fra Morphing Matter Lab at Carnegie Mellon University viser fram ny materialteknologi, med særlig fokus på hvordan man kan få materialer til å skifte form. bruksområdene er mangfoldige, som å sende flatpakkede pastaskruer til katastrofeområder eller møbler som forvandler seg fra en todimensjonal til en tredimensjonal form etter at man har pakket den ut hjemme i stua.

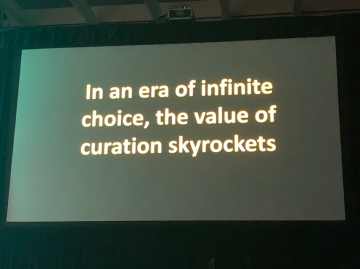

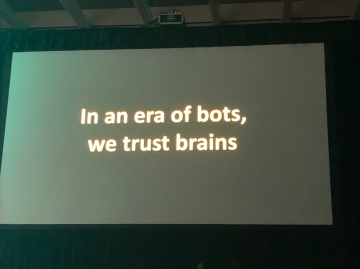

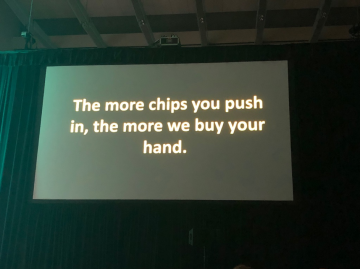

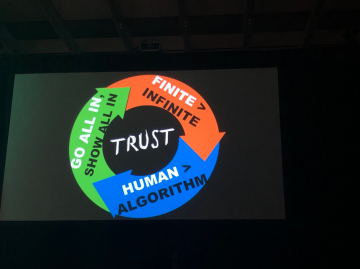

11.00: Neil Pasricha – Building Trust in Distrustful Times

Selvhjelpsforfatter Neil Pasricha, med bøker som The book of Awsome og The Happiness Equation gir sine bud til mediefolk og andre innholdsprodusenter som vil bygge tillit. Bildene taler for seg, egentlig.

14.00: The Second Golden Age of Audio – Podcasting med Alex Heath fra Cheddar, Matt Lieber fra Gimlet Media, Michael Mignano fra Anchor og Dawn Ostroff fra Spotify.

Utgangspunktet for samtalen er Spotifys satsing på podkast, som ikke minst ble synlig gjennom oppkjøpet av Gimlet Media (innholdsprodusent) og Anchor (en hosting-tjeneste og en kommersialiseringsplattform). I tillegg vokser podkasttallene enormt i USA. For Spotify var det naturlig å gå inn i podkast for å opprettholde ambisjonen om å være verdensledende på lyd.

Ifølge Gimlet er det på Spotify lytterveksten er størst for tiden. 15-20 prosent av lyttingen kommer nå derfra. Ser for seg at Spotify-lytting vil dominere den neste bølgen av podkastvekst.

Samtidig er det avgjørende for Gimlet å få ut mer tall enn det man har klart til nå. Det dreier seg både om å ha noe å vise annonsører og om å gjøre redaksjonelle valg basert på data.

12-24-åringer er den raskest voksende gruppen av podkastlyttere i USA i dag. De lytter via Spotify. 40 prosent av alle nye podkaster som er lansert i USA i 2018 ble samtidig hostet av Anchor.

Ifølge Spotify spiller podkast en stor rolle i deres langsiktige strategi. Tallene viser også at de som lytter til podkast på plattformen også lytter mer til musikken.

Gimlets erfaringer når det gjelder spørsmålet om hva slags innhold som fungerer dreier seg om:

- Å bli fortalt en historie (med følelse og innlevelse), med dramaturgi og spenning og vendepunkter.

- Å forstå noe nytt

- Å få følelsen av å ha en, eller være noens, følgesvenn.

Spotify lager allerede noe podkastinnhold selv, og vil forsøke mer: Sport, komikk, krim og fiksjon peker seg ut.

Reklamemarkedet på podkast er i sterk vekst. Allerede 514 millioner USD. Ifølge Spotify er antakelsen at mer av reklemamarkedet vil migrere til podkast de nærmeste årene.

Annonsørene vil ha en følelse av at reklamene er «incrimental to the experience», litt som i glossy magasiner. For lytteren virker annonseringen dermed mindre påtrengende enn ellers.

Anchor tilbyr programmatisk annonsering, noe som fungerer godt for mindre podkaster (Dette kunne bryte med ønsket om at annonsene skal være en sømløs og integrert del av helheten, men Anchor løser dette ved at det er verten selv som leser annonsene).

Et tips er å lage en podkast som er evergreen. Små podkaster kan tjene penger.

Spotify løser problemet med data. Her får Gimlet (og andre) mer tilbake enn tidligere, noe annonsørene også setter pris på.

Spotify tenker seg ikke eksklusivitet for enkelte populære programmer for å få flere til å bruke deres plattform. Ikke i utgangspunktet. Over tid, når dette modnes, kan det endre seg. Vil eksperimentere, ikke minst med tidsvinduer, kuratering av lister, personliserte anbefalinger og så videre. Sa imidlertid ingenting om abonnementspreget som kjennetegner podkastlytting og sikrer lojalitet hos lytterne.

15.30: Al Byrnes - Could JFK Be The Next American President?

Presentasjon av prosjektet JFK Unsilenced, som handler om å bruke JFKs egen stemme til å holde talen han faktisk skulle ha holdt da han ble skutt og drept i Dallas i 1963.

Deretter presentasjon av tanken om at man kunne få ham til å stille som presidentkandidat ved hjelp av samme teknikk. Tanken er ikke så fjern som den høres ut. I Japan har en robot allerede stilt til valg.

Presentasjonen handlet om hvordan noe slikt eventuelt kunne gjøres. Og: Kunne en kunstig intelligens virkelig bli en politisk leder?

Helt uavhengig av deep fakes, påvirkningsoperasjoner og innblanding i valg, er det kanskje verdt å stille seg noen spørsmål også om politikkens framtid. Teknologiutviklingen vil med nødvendighet påvirke også den.

13. mars 2019

11.00: Death to Roadways – Ending Traffic with Flying Cars med Shivika Sahdev (McKinsey), Aarti Shahani (NPR), Jaiwon Shin (NASA) og Michael Thacker (Bell).

Panel med focus på de praktiske og regulatoriske hindringene for en revolusjon i personlig mobilitet.

14.00: Designing for Self Driving – A New Kind of Ride med Ryan Powell fra Waymo.

Interessant om hvordan man designer brukeropplevelsen i selvkjørende biler hos Waymo.

14. mars 2019

14.00: CANNABIS – From Fringe Issue to Big Industry. Troy Dayton fra The ArcView Group, intervjuet av David Downs fra Leafly.

Cannabisindustrien er i lynrask vekst.

15.30: Joseph Lubin (Etherum og ConsenSys) intervjuet av Nanousg Zomorodi (Stable Genius Productions)

Dypdykk i lovnadene og begrensningene knyttet til kryptovaluta. Spesielt interessant at dette ikke bare kan brukes i finanstransaksjoner, men også i andre sammenhenger der tillit er sentralt.

Sjekk ut Civil, et samarbeid for etisk journalistikk og ConcesSys, et system for å etablere enighet.

Et problem med kryptovaluta er skalerbarhet fordi det tar lang tid å foreta regneoperasjonene som garanterer troverdige transaksjoner. Man snakker derfor om å etablere «lag to skalerbarhet». Lublin lover millioner av transaksjoner per sekund. Han er i ferd med å bygge etherum 2.0. 18-24 måneder fra nå av er planen en løsning som er mye mindre energikrevende og mye mer skalerbart. Hovedgrepet er å etablere underprotokoller som sjekkes opp mot en hovedprotokoll med jevne mellomrom.